Quase metade das indústrias já usa IA e especialistas alertam para riscos

26 novembro 2025 às 11h03

COMPARTILHAR

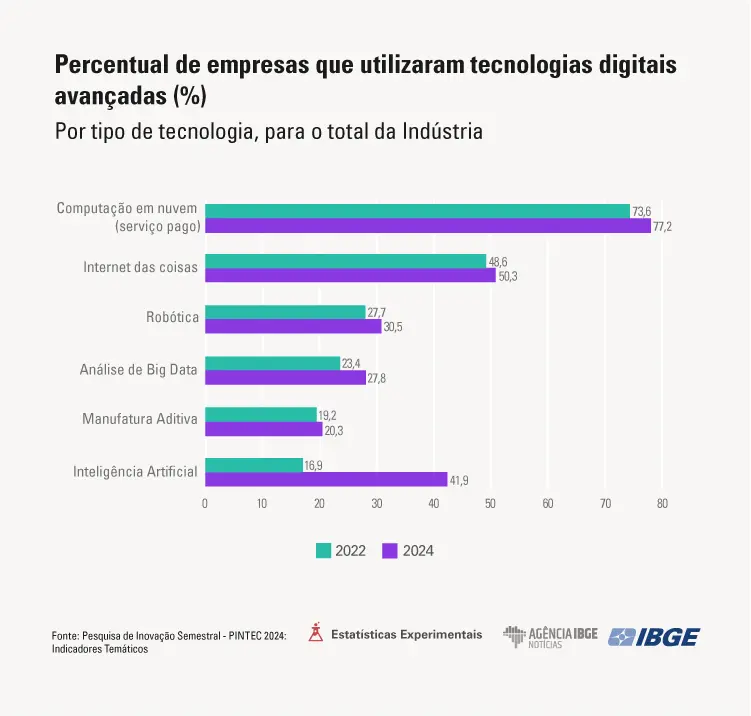

O Instituto Brasileiro de Geografia e Estatística (IBGE) aponta que, das 10.167 empresas industriais com 100 ou mais pessoas ocupadas, 89,1% utilizam ao menos uma das tecnologias avançadas investigadas pela pesquisa: análise de big data, computação em nuvem, inteligência artificial, internet das coisas, manufatura aditiva e robótica. Especificamente sobre o uso de IA, em 2024 o percentual chegou a 41,9% entre as indústrias, um avanço expressivo em relação aos 16,9% registrados em 2022.

Ainda de acordo com o levantamento do IBGE, as áreas que mais utilizaram inteligência artificial foram Administração (87,9%), Comercialização (75,2%) e Desenvolvimento de projetos de produtos, processos e serviços (73,1%). A área de Produção aparece em seguida, com 52%, registrando queda de 4,4 pontos percentuais em comparação a 2022 (56,4%). De toda forma, todas as áreas já sentem os impactos da inteligência artificial — algumas de forma mais intensa, outras em ritmo mais gradual.

O Jornal Opção entrevistou especialistas para trazer uma análise mais humanizada sobre esses dados estatísticos. O primeiro foi o jornalista e especialista em Mídias Digitais e Inteligência Artificial, Carlos Willian Leite. Segundo ele, em áreas como tecnologia, marketing digital, finanças, atendimento ao cliente, desenvolvimento de software, mídia e entretenimento, o impacto da IA é bastante visível. Exemplos disso são a automação de tarefas, a produção de textos e imagens em segundos, previsões de comportamento e serviços cada vez mais personalizados.

Na medicina, no direito, na engenharia, na educação, na administração pública e na indústria em geral, a IA surge como apoio à tomada de decisão: organiza grandes volumes de dados, facilita simulações e acelera rotinas que antes eram muito mais lentas. “Até profissões consideradas muito humanas para serem afetadas pela tecnologia — como psicologia, arte, ensino, comunicação e gestão de pessoas — já começam a usar essas ferramentas como assistentes, seja para rascunhar ideias, estruturar textos ou ajudar a pensar caminhos. O que muda é o jeito de trabalhar”, explica Carlos Willian.

Ainda na visão do especialista, a atitude mais inteligente para um profissional não é fechar os olhos e fingir que nada está acontecendo, nem tratar a IA como um oráculo que sempre acerta. “O mais razoável é enxergar essas ferramentas como um copiloto, algo que ajuda a ampliar a análise, sugerir possibilidades e tirar do caminho o trabalho repetitivo, mas que não substitui julgamento, responsabilidade e experiência”, complementa.

Coautor do livro “OAB GO NEXT”, que aborda tecnologia e inovação no cenário atual da advocacia, o secretário-geral da Comissão de Direito Civil da OAB/GO, Vinicius Serafim, recomenda utilizar a IA como ferramenta, e não como autora. Ele explica que, quando o usuário toma decisões jurídicas, financeiras ou estratégicas baseadas apenas em respostas geradas por IA, assume integralmente o risco dessas escolhas.

O especialista também defende a criação de uma regulamentação específica para ferramentas jurídicas. “O PL nº 2.338/2023 estabelece um marco regulatório para a IA, criando obrigações de transparência, remuneração de autores de conteúdo e a formação de um Sistema Nacional de Regulação e Governança de IA. O texto segue agora para análise na Câmara dos Deputados, onde será discutido, votado e, se aprovado, sancionado pelo presidente da República”, contextualiza.

Ainda segundo Vinicius Serafim, uma regulamentação específica para Inteligência Artificial, que prestam auxílio em serviços jurídicos permitiria definir o que configura “ação privativa da advocacia” e o que é “suporte automatizado”. “Além de exigir mecanismos de transparência nos sistemas de IA (como indicar origem de jurisprudência usada, auditoria de algoritmo, grau de confiabilidade), atribuir responsabilidade por eventuais danos causados por aconselhamento incorreto e por fim, garantir que o advogado mantenha o papel de decisão e controle humano da atuação jurídica”, finaliza.

Para além da área jurídica, Carlos Willian explica que se um investidor decide aplicar dinheiro, um médico indica um tratamento ou um gestor público celebra um contrato com base em algo que a IA sugeriu, a responsabilidade continua recaindo sobre essa pessoa ou sobre a instituição a que ela está vinculada. “O profissional não pode simplesmente dizer que foi a IA que falou para se livrar de um erro, de um dano ou de uma infração ética”.

Questões éticas envolvidas no uso da IA

A adoção de sistemas avançados de automação e análise de dados tem levantado uma série de questões éticas no campo tecnológico. A primeira preocupação está ligada ao viés algorítmico e à discriminação. “Modelos treinados com bases de dados desbalanceadas tendem a reproduzir e amplificar desigualdades já existentes, afetando especialmente grupos historicamente vulneráveis em áreas como crédito, seleção de candidatos e segurança pública”, alerta Carlos Willian.

Outro ponto que precisa ser observado é o impacto sobre o mercado de trabalho, como aponta o especialista. “A automação pode substituir tarefas humanas sem que existam políticas de transição justa”. Carlos Willian diz ainda que as empresas que dominam infraestrutura e dados ganham vantagem competitiva significativa, o que amplia assimetrias de poder. Ao mesmo tempo, falhas de segurança ou uso deliberadamente indevido dessas tecnologias podem gerar danos em larga escala, o que reforça a necessidade de regulação e supervisão constante.

Leia também: